Zašto Je Robots.txt Ključan Za Tehnički SEO

Robots.txt i Njegova Važnost

Sadržaj

- Uvod

- Što je robots.txt?

- Kako funkcionira robots.txt?

- Disallow i Allow direktive

- User-agent direktive

- Sintaksa robots.txt datoteke

- Zašto je robots.txt ključan za tehnički SEO?

- Kontrola indeksiranja

- Zaštita osjetljivih podataka

- Optimizacija brzine učitavanja stranice

- Smanjenje opterećenja poslužitelja

- Kako pravilno konfigurirati robots.txt?

- Dobri primjeri robots.txt datoteka

- Uobičajene pogreške i kako ih izbjeći

- Robots meta oznaka kao alternativa

- Zaključak

Uvod

Jedan od najvažnijih elemenata tehničkog SEO-a je upravljanje robots.txt datotekom. Neophodna je za kontroliranje indeksiranja vaše web stranice od strane tražilica i omogućava vam pravilno usmjeravanje crawlera. U ovom blog postu ćemo istražiti što je robots.txt, kako on funkcionira, zašto je ključan za tehnički SEO i kako ga pravilno konfigurirati.

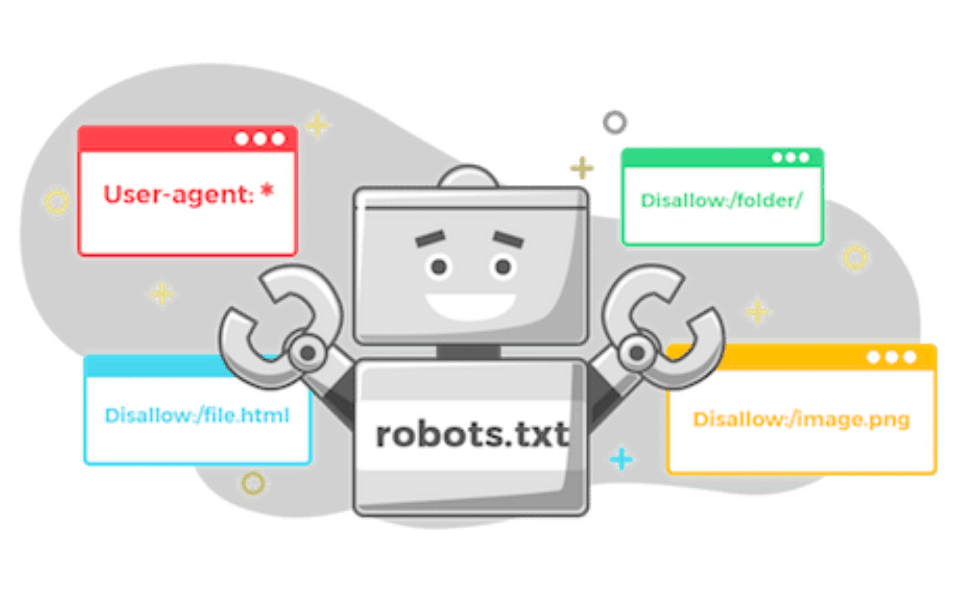

Što je robots.txt?

Robots.txt je tekstualna datoteka koja je smještena na korijenu vaše web stranice i koja služi za komunikaciju između web poslužitelja i web crawlera ili “robota”. Ona daje upute crawlerima o tome kako trebaju indeksirati i pristupiti određenim dijelovima vaše web stranice.

Iako je robots.txt javno dostupan, on ne sprječava neovlašten pristup od strane korisnika ili aplikacija. Njegova svrha je isključivo komunikacija s web crawlerima i određivanje pravila indeksiranja.

Kako funkcionira robots.txt?

Robots.txt koristi nekoliko ključnih komponenata kako bi pružio upute web crawlerima. Ove komponente uključuju Disallow i Allow direktive, kao i User-agent direktive.

Disallow i Allow direktive

Disallow i Allow direktive koriste se za određivanje koje dijelove vaše web stranice crawlerima treba zabraniti ili dopustiti. Disallow direktiva specificira sadržaj koji se ne smije indeksirati, dok Allow direktiva specificira sadržaj koji je dopušten za indeksiranje.

Primjer uporabe Disallow direktive:

User-agent: *

Disallow: /privatni/Ovaj primjer zabranjuje pristup direktoriju “privatni” svim web crawlerima.

Primjer uporabe Allow direktive:

User-agent: Googlebot

Disallow: /privatni/

Allow: /privatni/stranica.htmlOvaj primjer zabranjuje pristup direktoriju “privatni” svim web crawlerima osim Googlebotu. Također dopušta pristup određenoj stranici unutar tog direktorija.

User-agent direktive

User-agent direktive identificiraju web crawlerima za koje su određene upute primjenjive. Najčešći User-agent je “*” koji se odnosi na sve web crawlere. Također je moguće specifično navesti User-agent za primjenu određenih uputa samo na određeni web crawler.

Primjer uporabe User-agent direktive:

User-agent: *

Disallow: /privatni/Ovaj primjer primjenjuje zabranu pristupa direktoriju “privatni” na sve web crawlere.

Sintaksa robots.txt datoteke

Robots.txt datoteka koristi jednostavnu sintaksu koja se sastoji od organskog teksta i upute. Evo osnovne sintakse:

User-agent: [naziv web crawlera]

Disallow: [putanja do zabranjenog sadržaja]

Allow: [putanja do dopuštenog sadržaja]Napomena: Važno je napomenuti da robots.txt datoteka mora biti ispravno nazvana “robots.txt” i smještena na korijenu vaše domene.

Zašto je robots.txt ključan za tehnički SEO?

Kao što je već spomenuto, robots.txt datoteka je ključna za tehnički SEO iz nekoliko razloga. Evo nekoliko ključnih razloga zašto je robots.txt važan za svaku web stranicu.

Kontrola indeksiranja

Jedan od osnovnih razloga zašto je robots.txt ključan za tehnički SEO je kontrola indeksiranja web stranice od strane tražilica. Bez robots.txt datoteke, web crawleri će indeksirati sve što im je dostupno na web stranici. To može rezultirati neželjenim indeksiranjem stranica koje uopće ne želite da budu vidljive na tražilicama.

Robots.txt vam omogućava precizno određivanje koje stranice, direktoriji ili datoteke želite blokirati od indeksiranja. Ovo je vrlo važno za web stranice koje imaju osjetljive ili privatne informacije koje ne želite da budu dostupne javno.

Zaštita osjetljivih podataka

Robots.txt datoteka je izuzetno važna za zaštitu osjetljivih podataka na web stranici. To može uključivati korisničke račune, baze podataka, privatne dokumente i slično. Blokiranjem pristupa ovim dijelovima web stranice putem robots.txt, smanjuje se rizik od neovlaštenog pristupa ili indeksiranja tih podataka od strane tražilica.

Važno je napomenuti da robots.txt datoteka ne pruža potpunu sigurnost i enkripciju podataka. Ona samo sprječava indeksiranje osjetljivih podataka od strane tražilica. Dodatne sigurnosne mjere, poput lozinki, enkripcije podataka i autentikacije, također su potrebne za potpunu zaštitu osjetljivih informacija.

Optimizacija brzine učitavanja stranice

Robots.txt datoteka također može doprinijeti optimizaciji brzine učitavanja web stranice. Kada web crawleri pristupaju vašoj web stranici, oni troše resurse vašeg poslužitelja i mreže. To može dovesti do povećanog opterećenja poslužitelja i sporijeg učitavanja web stranice za korisnike.

Pravilno konfiguriran robots.txt vam omogućava kontrolu nad tim resursima i može smanjiti opterećenje poslužitelja, posebno na dijelovima web stranice koji su manje važni ili često ažurirani. Na taj način se oslobađaju resursi za ključne dijelove web stranice i poboljšava ukupna brzina učitavanja.

Smanjenje opterećenja poslužitelja

Robots.txt datoteka također igra važnu ulogu u smanjenju opterećenja poslužitelja. Kada web crawleri indeksiraju vašu web stranicu, oni generiraju dodatni promet i opterećenje na poslužitelju. Ova dodatna opterećenja mogu dovesti do usporavanja web stranice ili čak do preopterećenja poslužitelja.

Konfiguracija robots.txt omogućava vam da precizno odredite koje stranice ili dijelove web stranice tražilice mogu indeksirati. Na primjer, možete zabraniti pristup dijelovima web stranice koji nisu relevantni za indeksiranje, poput izvanrednih arhiva ili generiranih sadržaja. Na taj način smanjujete opterećenje poslužitelja i poboljšavate performanse web stranice.

Kako pravilno konfigurirati robots.txt?

Pravilna konfiguracija robots.txt datoteke ključna je za uspješno upravljanje web crawlerima i indeksiranjem vaše web stranice. Evo nekoliko smjernica i primjera kako pravilno konfigurirati svoj robots.txt.

Dobri primjeri robots.txt datoteka

Pravilno konfiguriran robots.txt može izgledati ovako:

User-agent: *

Disallow: /privatni/

Disallow: /admin/

Allow: /stranica.html

Allow: /slika.jpgU ovom primjeru su svi web crawleri zabranjeni pristupiti direktorijima “privatni” i “admin”. Međutim, dopušten je pristup specifičnoj stranici i slici.

Ako želite primijeniti specifične upute na određenog web crawlera, primjer bi mogao izgledati ovako:

User-agent: Googlebot

Disallow: /privatni/

Allow: /privatni/stranica.html

User-agent: Bingbot

Disallow: /admin/

Allow: /admin/slika.jpgU ovom primjeru, Googlebotu je zabranjen pristup direktoriju “privatni”, ali mu je dopušten pristup specifičnoj stranici. S druge strane, Bingbotu je zabranjen pristup direktoriju “admin”, osim pristupa određenoj slici.

Uobičajene pogreške i kako ih izbjeći

Prilikom konfiguriranja robots.txt datoteke, postoje neke uobičajene pogreške koje treba izbjegavati. Evo nekoliko primjera tih pogrešaka i kako ih ispraviti:

- Zabrana pristupa cijeloj web stranici: Ako upotrijebite sljedeću direktivu, crawleri će biti spriječeni pristupiti bilo kojem dijelu web stranice.

User-agent: *

Disallow: /Ovo nije željeni rezultat jer će cijela web stranica biti izuzeta od indeksiranja. Umjesto toga, specifično navedite dijelove koje želite zabraniti indeksiranje.

-

Dupliranje uputa: Dupliranje uputa u robots.txt može dovesti do nesporazuma i neočekivanog rezultata. Budite sigurni da svaka uputa jasno izražava vaše namjere.

-

Ignoriranje velikog slova: Robots.txt datoteka je osjetljiva na velika i mala slova. Ako zanemarite ovu razliku, to može rezultirati krivim uputama i pogrešnom indeksacijom stranica.

-

Nepostojanje robots.txt datoteke: Kako bi crawleri točno znali koje su upute primjenjive, važno je osigurati da postoji robots.txt datoteka na korijenu web stranice. Ako datoteka nedostaje, to može dovesti do indeksiranja stranica koje nisu predviđene za javnu objavu.

Robots meta oznaka kao alternativa

Uz korištenje robots.txt datoteke, također postoji opcija korištenja Robots meta oznake u HTML-u kao alternative. Robots meta oznaka koristi se za precizno kontroliranje indeksiranja pojedinih stranica, umjesto cijele web stranice.

Primjer uporabe Robots meta oznake:

<meta name="robots" content="noindex, nofollow">Ova oznaka govori tražilicama da ne indeksiraju ili slijede vezu na određenoj stranici. Time se omogućava detaljnija kontrola nad indeksiranjem svake pojedine stranice na web mjestu.

Robots meta oznaka se može koristiti u kombinaciji s robots.txt datotekom kako bi se pružila preciznija kontrola indeksiranja.

Zaključak

Robots.txt datoteka je ključna komponenta tehničkog SEO-a i omogućava vam precizno upravljanje indeksiranjem vaše web stranice. Ona vam omogućava kontrolu indeksiranja, zaštitu osjetljivih podataka, optimizaciju brzine učitavanja stranice i smanjenje opterećenja poslužitelja. Pravilno konfiguriranje robots.txt datoteke je važno za svaku web stranicu kako bi se postigla optimalna vidljivost i performanse.

Kako bi se osiguralo pravilno konfiguriranje robots.txt datoteke, važno je izbjegavati uobičajene pogreške poput zabrane pristupa cijeloj web stranici, dupliranja uputa ili ignoriranja velikih slova. Također je dobra praksa koristiti Robots meta oznaku u HTML-u za dodatnu kontrolu indeksiranja pojedinih stranica.

Nadamo se da vam je ovaj blog post pružio korisne informacije o važnosti i upotrebi robots.txt datoteke u tehničkom SEO-u. Iskoristite ove smjernice kako biste optimizirali svoju web stranicu i postigli bolje rezultate u tražilicama.

0 thoughts on “Zašto Je Robots.txt Ključan Za Tehnički SEO”